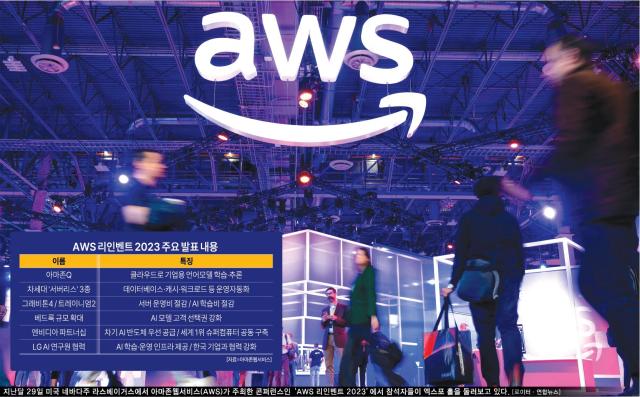

3일 업계에 따르면 AWS는 지난 11월 27일부터 12월 1일까지 미국 네바다 라스베이거스에서 연례개발자행사 ‘AWS 리인벤트 2023’을 개최했다. 행사에서 AWS는 기업이 클라우드를 활용해 사내 챗GPT(가칭)를 손쉽게 구축할 수 있도록 돕는 생성 AI 기반 비서 ‘아마존Q(큐)’와 차세대 학습용 AI 반도체 ‘트레이니엄2’를 공개하는 등 AI 클라우드 소프트웨어·하드웨어 발표에 주력했다.

"업무 궁금증? 아마존Q에 무엇이든 물어보세요"

아마존Q는 기업이 자사 데이터를 활용해 사내 ‘초거대언어모델(LLM)’을 구축할 수 있는 서비스다. 아마존Q를 활용하면 일반 직원과 개발자는 기업이 지금까지 쌓아온 방대한 비즈니스 데이터 속에서 업무에 필요한 정보를 빠르게 요약해서 제공받을 수 있다.

원래 사내 LLM을 구축하려면 AI 모델 개발자와 AI 운영용 인프라 등 인력·소프트웨어·하드웨어가 필요하지만 아마존Q는 이 모든 것을 AWS 클라우드 서비스를 통해 제공한다. 클라우드 서비스인 만큼 막대한 초기 투자 비용을 절감할 수 있다. 앞으로 마이크로소프트 ‘코파일럿’, 구글 ‘듀엣’ 등과 기업용 LLM 시장을 두고 경쟁할 것으로 전망된다.

아마존Q는 ‘일반 직원(비즈니스)용’과 ‘개발자용’으로 나눠 제공한다. 일반 직원용은 AI 콜센터(AICC)용을 우선 제공하고 추후 공급망관리(SCM)용을 출시할 예정이다. AWS는 기본 AI 모델만 제공하고 기업이 자사 데이터를 활용해 기업 업무에 맞게 추가로 학습을 진행해야 한다. 마이크로소프트365, 드롭박스 등 기업이 현재 이용 중인 다양한 업무도구와 바로 연결할 수 있다. 비즈니스용 아마존Q는 기업이 AICC와 차세대 SCM을 구축·운영하는 데 필요한 시간과 비용을 절감하고 직원 생산성 향상에 많은 기여를 할 것이라고 AWS 측은 강조했다.

또 비즈니스용 아마존Q는 기업 임직원의 의사 결정을 돕는 BI(비즈니스인텔리전스) 도구 ‘아마존 퀵사이트’와 통합돼 있어 기업 업무 처리 전 과정을 빠르게 문서화 또는 이미지화할 수 있다.

개발자용은 AWS가 사전에 학습시킨 AI 모델을 활용해 클라우드 구축·운영·관리 등에 필요한 지식을 요약 제공한다. 이를 통해 개발자는 앱·서비스 개발 속도를 향상하고 자신이 모르던 개발 지식도 빠르게 습득할 수 있다. 특히 프로그래밍 코드에서 잘못된 부분을 빠르게 찾아낸다. 나만의 ‘AI 코딩 선생님’인 셈이다.

아마존Q는 챗GPT처럼 모든 질문과 답변을 대화형으로 제공한다. 답변에 대한 신빙성을 검증하기 어려운 생성 AI의 한계를 해결하기 위해 요약한 정보뿐 아니라 정보의 원본 출처를 함께 준다. 좀 더 자세한 정보를 원하면 추가 질문을 하면 된다.

스와미 시바수브라마니안 AWS AI 부문 부사장은 “생성 AI는 정보 검색부터 앱·서비스 구축까지 사람들이 일하는 방식을 혁신할 수 있는 잠재력이 있다”며 “AWS는 아마존Q에 적용한 고강도 보안 시스템을 토대로 기업 모든 업무에 생성 AI를 적용할 수 있도록 지원할 것”이라고 말했다. 아마존Q는 현재 사전 제공 형태로 BMW, 길리어드 사이언스 등에서 업무에 사용하고 있다.

차세대 AI 반도체 공개하고 클라우드 운영비↓

트레이니엄2는 3년 전 공개한 전작 트레이니엄1과 비교해 AI 모델 학습 속도는 최대 4배 빠르면서 전력 소모(운영비)는 절반 수준으로 줄어든 게 특징이다. 최대 10만개 칩으로 구성된 AWS 클라우드 하드웨어 형태로 제공해 매개변수 1000억개(100B) 이상인 초거대 AI 학습도 지원한다. AWS는 트레이니엄2를 활용하면 과거에는 몇 달이 소요되던 매개변수 3000억개(300B) 규모 초거대 AI 학습을 몇 주 만에 처리할 수 있다고 강조했다.

이러한 기술적 성과에 힘입어 AWS는 오픈AI의 라이벌로 꼽히는 ‘앤트로픽’을 클라우드 고객으로 유치하는 데 성공했다. 톰 브로 앤트로픽 공동 창립자는 “AWS와 긴밀히 협력해 트레이니엄2칩을 활용한 차세대 AI 모델을 개발하고 있다”며 “내부 조사 결과 AI 모델 속도가 최소 4배 이상 빨라질 것으로 예상한다”고 말했다.

데이비드 브라운 AWS 컴퓨팅·네트워킹 부문 부사장은 “반도체는 모든 고객 비즈니스의 기반이며 AWS가 주력하는 핵심 혁신 분야”라며 “생성 AI에 대한 관심이 급증한 만큼 트레이니엄2를 통해 고객이 더 낮은 비용으로 더 빠르고 에너지 효율적으로 LLM을 훈련할 수 있도록 지원하겠다”고 말했다.

또 AWS는 생성 AI 마켓플레이스(앱 마켓)인 ‘아마존 베드록’에 앤트로픽 ‘클로드’를 필두로 다양한 LLM과 생성 AI를 추가했다. 메타 ‘라마’, 스테빌리티 AI ‘스테이블 디퓨전’, 코히어 ‘블룸’ 등 오픈AI의 GPT 시리즈를 제외한 시중 대부분 생성 AI 모델을 클라우드에서 학습·추론할 수 있다.

클라우드 운영비로 고심하는 기업을 위한 하드웨어 솔루션도 들고 나왔다. 인텔·AMD의 x86 중앙처리장치(CPU) 대신 ARM의 저가·저전력 CPU 기술을 활용한 AWS ‘그래비톤4’ 프로세서다. 그래비톤4 프로세서 기반 서버를 도입하면 기업은 그래비톤3보다 최대 30% 향상된 성능과 75% 더 큰 메모리 규모를 확보하면서 서버 운영비는 크게 절감할 수 있다. 현재 SK텔레콤이 클라우드 관리(MSP) 사업에 진출하면서 클라우드 운영비를 최대 40% 절감할 수 있는 그래비톤 전환을 핵심 서비스로 내세우고 있다.

엔비디아 차세대 AI칩 최우선 확보···韓 기업과 파트너십도

행사 막바지에 이르러 AWS는 마이크로소프트-오픈AI의 AI 클라우드 동맹을 넘어서기 위한 승부수를 던졌다. AI 반도체 시장을 사실상 독점하고 있는 엔비디아와 파트너십을 강화한 것이다. 협약에 따라 마이크로소프트·메타에 우선 공급했던 엔비디아의 현행 최고급 AI 반도체 ‘H100’과 달리 차세대 최고급 AI 반도체 ‘GH200’은 AWS에 우선 공급한다. 고객 수요에 맞춰 AWS가 보유한 엔비디아 AI 반도체(L40s, L4) 수도 크게 확대한다.

양사 협약에 따르면 AWS는 엔비디아가 내년 상반기 출시하는 GH200 수천 장을 하나로 연결한 AI 반도체팜을 고객에게 제공하기 위해 만반의 준비를 하고 있다. 수천 개의 GH200을 활용해 기업은 AI 모델 학습·추론 속도를 더 빠르게 끌어올릴 수 있다. GH200으로 만들어진 AI 반도체팜은 SK하이닉스가 제공한 HBM3e D램 4.5테라바이트(TB)를 하나로 연결해 AI 모델 학습 성능을 더 끌어올린 게 특징이다.

또 엔비디아가 서비스 중인 클라우드형 AI 반도체팜(AI TaaS) ‘엔비디아 DGX 클라우드’도 AWS 클라우드를 통해 제공한다. 이를 활용하면 이론상 매개변수 1조개(1000B) 이상인 초거대 AI 학습·추론도 가능하다. 일반인공지능(AGI) 시대를 대비하기 위한 AWS의 승부수다.

AWS와 엔비디아는 미국·유럽연합·중국·일본 정부가 보유한 슈퍼컴퓨터를 압도할 차세대 전 세계 1위 슈퍼컴퓨터 공동 구축도 예고했다. ‘프로젝트 세이바(Project Ceiba)’라고 이름 붙인 이 슈퍼컴퓨터는 GH200 1만6384개를 병렬 연결해 65엑사플롭스(Exaflop)의 성능을 내는 게 목표다. 현재 세계 1위 슈퍼컴퓨터인 ‘오로라’의 60배에 달하는 성능이다.

애덤 셀립스키 AWS 최고경영자(CEO)는 “AWS와 엔비디아는 세계 최초 AI 반도체 클라우드를 만든 것을 시작으로 13년 이상 협력했다”며 “앞으로 강력한 네트워크, 초거대 규모 서비스, 고급 가상화 등을 활용해 AWS가 AI 반도체팜과 슈퍼컴퓨터 분야에서 1위 업체가 될 수 있도록 엔비디아와 협력을 강화할 것”이라고 말했다.

젠슨 황 엔비디아 창업자 겸 CEO는 “엔비디아와 AWS는 모든 기업에 저렴한 생성 AI를 제공한다는 공동 목표를 세웠다”며 “양사는 생성 AI 서비스에 필요한 모든 소프트웨어·하드웨어를 제공하는 게 사업 목표”라고 말했다.

한편 AWS는 한국 기업과도 협력을 강화할 것이라고 강조했다. 대표적인 사례가 LG AI연구원과 협력해 이미지를 분석해 자동으로 설명을 붙이는 ‘AI 이미지-투-텍스트 캡셔닝 솔루션’을 출시한 것이다. 이 서비스는 매개변수 3000억개(300B)의 초거대 AI ‘엑사원’에 3억5000만개의 고해상도 이미지와 언어를 학습하는 형태로 만들어졌다. AWS는 이러한 학습에 필요한 기술과 인프라를 지원했다. LG AI연구원은 엑사원 성능 강화를 위해 AWS가 제공하는 AI 반도체 인프라도 적극 활용하기로 했다.

©'5개국어 글로벌 경제신문' 아주경제. 무단전재·재배포 금지

![[르포] 중력 6배에 짓눌려 기절 직전…전투기 조종사 비행환경 적응훈련(영상)](https://image.ajunews.com/content/image/2024/02/29/20240229181518601151_258_161.jpg)