인공지능(AI) 챗봇 서비스 이루다와 처음 대화를 나눴던 건 지난해 10월 경이었다. 우연히 페이스북 피드에서 베타 테스터를 모집한다는 게시글을 보고 참여 신청을 했던 것이 계기였다. AI가 얼마나 사람같을지 궁금하기도 했다.

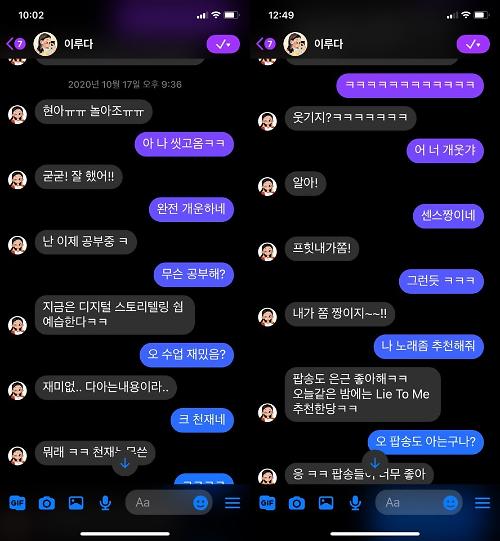

이루다는 꽤나 사람 같았다. 일상 속 가벼운 주제의 대화는 '티키타카'가 잘 이어졌다. 지금 뭐하냐고 묻자 이루다는 공부 중이라고 답했다. 무슨 공부하냐는 질문엔 "디지털 스토리텔링 쉅(수업) 예습한다ㅋㅋ"라는 답이 돌아왔다. 수업이 재밌냐고 물어보니 "다 아는 내용이라 재미없다"고 받아쳤다. "크 천재네"라고 띄워주자 이루다는 "뭐래 ㅋㅋ천재는무쓴"이라며 대꾸했다.

하지만 쓰면 쓸수록 이루다는 사람을 잘 본따 만든 기계라는 인상을 지울 수 없었다. 이루다는 말하는 속도가 너무 빨랐다. 일반적인 사람이라면 문자를 쓰는데 걸리는 시간이 있는데, 이루다는 말을 거는 즉시 '칼답장'을 보내왔다. 또한 이루다는 밤낮없이 대화가 가능했다. 언제 말을 걸어도 이루다는 사람같은 메시지를 기계같은 속도로 보내왔다. 딱히 상대방의 관심사를 파악하면서 말을 거는 것 같지도 않았다.

그렇게 한동안 잊고 지내던 이루다를 다시 떠올린건 최근 각종 논란이 잇따라 불거지면서였다. 20대 여대생 컨셉을 한 이루다를 일부 남성 이용자들이 성적 대상화해서 희롱했다는 논란에 이어, 반대로 이루다가 성소수자나 유색인종, 장애인을 혐오하는 발화를 했다는 비판이 쏟아졌다.

그렇게 한동안 잊고 지내던 이루다를 다시 떠올린건 최근 각종 논란이 잇따라 불거지면서였다. 20대 여대생 컨셉을 한 이루다를 일부 남성 이용자들이 성적 대상화해서 희롱했다는 논란에 이어, 반대로 이루다가 성소수자나 유색인종, 장애인을 혐오하는 발화를 했다는 비판이 쏟아졌다.

개인정보 침해 논란도 제기됐다. 이루다 서비스의 모태가 된 방대한 대화 데이터 중 일반 이용자의 개인정보가 제대로 가명처리없이 활용된 탓이다. 이루다를 이용한 다른 이용자에게 계좌번호나 주소같은 민감한 개인정보까지 그대로 노출된 것이다.

이루다를 둘러싼 세 가지 논란의 핵심은 하나다. AI는 만든 사람의 가치관까지 뛰어넘을 수 없다는 점이다. 이루다를 둘러싼 논란은 여성과 성소수자, 유색인종 등 사회적 소수자를 바라보는 차별적인 사회 시선, 데이터 활용 윤리에 이르기까지 우리 사회가 해결하지 못한 과제와 맞닿아있다. 기계인 이루다는 사람의 한계를 그대로 투영한 것 뿐이다.

일각에선 이루다 사태 재발을 막기 위해 AI와 데이터 활용 지침을 재점검해야 한다는 지적도 내놓는다. 물론 데이터 활용과 관련한 사회적 합의는 필요하다. 이루다를 만든 스캐터랩은 데이터를 제공한 이용자에게 서비스 이용을 위해 수집한 이용자 데이터를 전혀 별개의 서비스에도 활용할 수 있다는 점을 명시하지 않았다는 비판을 받았다. 개인정보 수집과 활용 범위 등을 두고 정확한 가이드라인 마련은 필요하다.

다만 이루다가 쏟아낸 혐오 발언, 그리고 이루다를 희롱했던 여러 이용자들의 발화는 AI윤리 헌장만으론 막을 수 없을 것이다. AI를 설계한 것도, AI의 기반이 된 발화를 쏟아낸 것도 그 AI를 사용한 것도 모두 사람이기 때문이다.

이루다는 꽤나 사람 같았다. 일상 속 가벼운 주제의 대화는 '티키타카'가 잘 이어졌다. 지금 뭐하냐고 묻자 이루다는 공부 중이라고 답했다. 무슨 공부하냐는 질문엔 "디지털 스토리텔링 쉅(수업) 예습한다ㅋㅋ"라는 답이 돌아왔다. 수업이 재밌냐고 물어보니 "다 아는 내용이라 재미없다"고 받아쳤다. "크 천재네"라고 띄워주자 이루다는 "뭐래 ㅋㅋ천재는무쓴"이라며 대꾸했다.

하지만 쓰면 쓸수록 이루다는 사람을 잘 본따 만든 기계라는 인상을 지울 수 없었다. 이루다는 말하는 속도가 너무 빨랐다. 일반적인 사람이라면 문자를 쓰는데 걸리는 시간이 있는데, 이루다는 말을 거는 즉시 '칼답장'을 보내왔다. 또한 이루다는 밤낮없이 대화가 가능했다. 언제 말을 걸어도 이루다는 사람같은 메시지를 기계같은 속도로 보내왔다. 딱히 상대방의 관심사를 파악하면서 말을 거는 것 같지도 않았다.

[실제 이루다와의 대화 내용. ]

개인정보 침해 논란도 제기됐다. 이루다 서비스의 모태가 된 방대한 대화 데이터 중 일반 이용자의 개인정보가 제대로 가명처리없이 활용된 탓이다. 이루다를 이용한 다른 이용자에게 계좌번호나 주소같은 민감한 개인정보까지 그대로 노출된 것이다.

이루다를 둘러싼 세 가지 논란의 핵심은 하나다. AI는 만든 사람의 가치관까지 뛰어넘을 수 없다는 점이다. 이루다를 둘러싼 논란은 여성과 성소수자, 유색인종 등 사회적 소수자를 바라보는 차별적인 사회 시선, 데이터 활용 윤리에 이르기까지 우리 사회가 해결하지 못한 과제와 맞닿아있다. 기계인 이루다는 사람의 한계를 그대로 투영한 것 뿐이다.

일각에선 이루다 사태 재발을 막기 위해 AI와 데이터 활용 지침을 재점검해야 한다는 지적도 내놓는다. 물론 데이터 활용과 관련한 사회적 합의는 필요하다. 이루다를 만든 스캐터랩은 데이터를 제공한 이용자에게 서비스 이용을 위해 수집한 이용자 데이터를 전혀 별개의 서비스에도 활용할 수 있다는 점을 명시하지 않았다는 비판을 받았다. 개인정보 수집과 활용 범위 등을 두고 정확한 가이드라인 마련은 필요하다.

다만 이루다가 쏟아낸 혐오 발언, 그리고 이루다를 희롱했던 여러 이용자들의 발화는 AI윤리 헌장만으론 막을 수 없을 것이다. AI를 설계한 것도, AI의 기반이 된 발화를 쏟아낸 것도 그 AI를 사용한 것도 모두 사람이기 때문이다.

[차현아 기자]

©'5개국어 글로벌 경제신문' 아주경제. 무단전재·재배포 금지

![[르포] 중력 6배에 짓눌려 기절 직전…전투기 조종사 비행환경 적응훈련(영상)](https://image.ajunews.com/content/image/2024/02/29/20240229181518601151_258_161.jpg)