오픈소스 생성 인공지능(AI)의 선두 주자인 메타가 구글과 수십억 달러 규모의 '텐서처리장치(TPU)' 구매 계약을 논의하는 것으로 알려지면서 그동안 엔비디아가 주도하던 인공지능(AI)칩 시장이 요동치고 있다. 이에 삼성전자와 SK하이닉스는 엔비디아로 일원화되어 있던 고대역폭메모리(HBM) 공급망을 구글, 브로드컴, 아마존, AMD, 오픈AI 등으로 다변화하며 메모리 슈퍼사이클(초호황) 기간 확장에 총력을 기울일 전망이다.

30일 디인포메이션 등 외신에 따르면 메타는 엔비디아 AI칩 물량 확보에 어려움을 겪음에 따라 자사 AI 데이터센터에 TPU를 도입하는 방안을 놓고 구글과 협의 중이다.

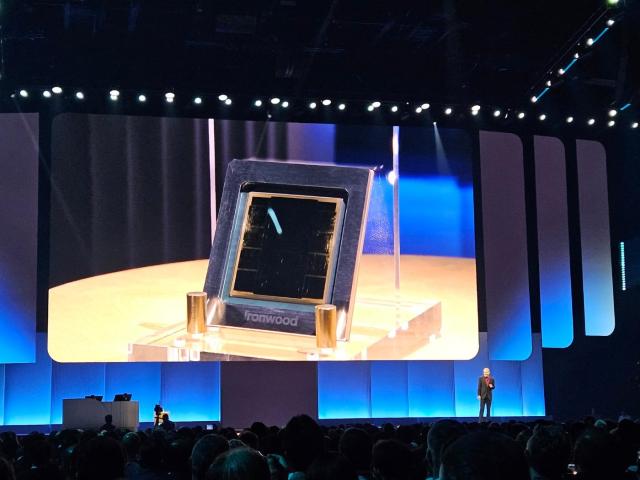

TPU는 구글이 AI 학습·추론을 위해 브로드컴과 협력해 개발한 AI 특화 반도체칩(ASIC)이다. 구글의 자체 생성 AI인 제미나이 개발뿐만 아니라 앤트로픽·오픈AI에도 도입되며 성능을 인정받았다. 그동안 클라우드를 통해 다른 기업에 임대해 왔으나, 이번 메타와의 계약은 TPU 실물을 메타 데이터센터에 공급하는 게 골자다. 구글은 메타뿐만 아니라 미국 대형 금융사와도 TPU 공급을 위한 논의를 하고 있는 것으로 알려졌다.

계약이 성사되면 구글은 엔비디아의 자리를 위협할 유력한 AI칩 공급자로 급부상할 전망이다. 젠슨 황 엔비디아 최고경영자(CEO)도 엔비디아 뉴스룸을 통해 "엔비디아는 업계보다 한 세대 앞서 있고 성능·적응성·상호운용성에서 ASIC보다 우위다"라고 경계하는 모습을 내비쳤다.

증권가에선 AI칩 시장이 엔비디아 독점 구도에서 경쟁 구도로 바뀌더라도 막강한 캐파(생산능력)를 바탕으로 삼성전자, SK하이닉스 등 한국 메모리 기업의 우위에는 변함이 없을 것으로 예측하고 있다.

TPU가 대표적인 사례다. TPU는 2017년 공개한 2세대 제품부터 HBM을 적용하는 등 그동안 AI ASIC에 HBM이 필수임을 입증해 왔다. 최신 버전인 7세대 TPU에는 HBM3E(5세대)를 6~8개 탑재했고, 내년 공개하는 8세대 TPU에는 HBM4(6세대)를 적용할 전망이다.

현재 구글은 HBM을 SK하이닉스와 삼성전자로부터 나눠 공급받는 것으로 알려졌다. 일례로 한국투자증권은 올해 구글 TPU의 HBM 채택 비중을 SK하이닉스 56.6%대 삼성전자 43.4%로 추정했다.

아마존, AMD, 오픈AI 등 자체 AI칩을 운용 중이거나 개발하려는 기업들도 HBM 채용에 적극적이다. 아마존은 이스라엘 팹리스 안나푸르나랩을 인수해서 자체 AI칩인 'AWS 트레이니엄'을 개발했다. 2세대 트레이니엄에는 HBM3(4세대)이, 올해 말 공개하는 3세대 트레이니엄에는 HBM3E가 적용될 전망이다. 아마존도 SK하이닉스와 삼성전자로부터 HBM을 공급받고 있다.

AMD는 올해 AI 학습·추론에 특화한 AI칩 '인스팅트 MI 355X'에 이어 내년 중 '인스팅트 MI 400X'를 출시하며 엔비디아를 뒤쫓고 있다. 샘 올트먼 오픈AI CEO는 "(AI 운영에) AMD 칩을 사용할 것"이라며 "사양을 들었을 때 믿을 수 없을 정도로 놀라운 아이디어라고 생각했다"고 평가했다. AMD는 현재 HBM을 전량 삼성전자로부터 공급받는 것으로 분석되고, SK하이닉스로 공급망 확대를 꾀하는 것으로 알려졌다.

브로드컴과 함께 자체 AI칩 개발을 추진 중인 오픈AI는 삼성전자와 SK하이닉스에 D램 웨이퍼 기준 월 최대 90만장 규모의 메모리 공급을 요청하며 두 회사 HBM 확보에 속도를 내고 있다.

©'5개국어 글로벌 경제신문' 아주경제. 무단전재·재배포 금지

![[르포] 중력 6배에 짓눌려 기절 직전…전투기 조종사 비행환경 적응훈련(영상)](https://image.ajunews.com/content/image/2024/02/29/20240229181518601151_258_161.jpg)