인간과 컴퓨터가 일상 언어로 소통하고 정보를 주고받게 해 주는 인공지능(AI) 기술이 주목받고 있다. 언어AI 기술을 IT 서비스와 프로그램에 구현하기 위한 언어AI 모델 연구가 활발하다. 최근 미국 기업 구글의 버트(BERT)와 오픈AI의 'GPT' 시리즈와 같은 언어AI 모델이 특히 뛰어난 성능을 보여 주며 세간의 관심을 모았다.

당초 영어만 읽고 쓸 줄 아는 두 언어AI 모델에 한국어를 가르친 전문가들이 국내에 있다. SK텔레콤 산하의 'AI랭귀지테크랩스(ALT Labs)' 소속 연구원들이다. 이들은 작년 10월과 올해 2월 각각 한국어를 익힌 코버트(KoBERT)와 KoGPT2를 선보였다. SK텔레콤 언어AI 기술 분야의 연구 성과와 발전 방향을 가늠하기 위해, 이들과의 서면 인터뷰를 진행했다.

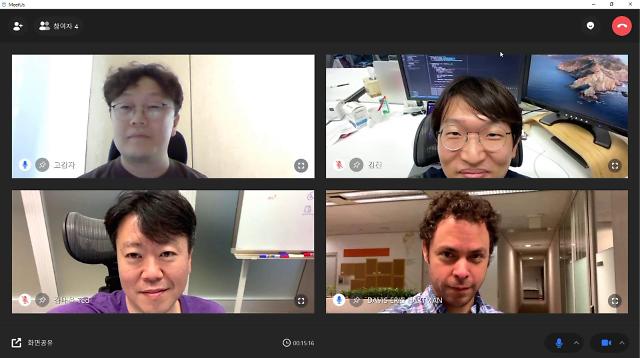

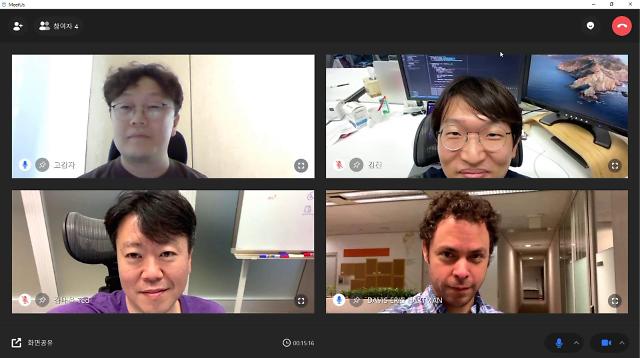

ALT Labs의 데이비스 에릭 하트만 소장, 김태윤 리더, 김진 리서치엔지니어, 전희원 리서치엔지니어, 4명이 함께 질의에 답했다. 지난주 보도된 "SK텔레콤은 '언어신동 AI’에 어떻게 한국어를 가르쳤을까"가 이번 인터뷰의 답변 가운데 극히 일부분만을 담은 첫 기사다. 전체 인터뷰 질의응답을 주제별로 재배치해 두 편으로 재정리했다.

후반부인 이번 편은 언어AI 분야의 성취와 한계에 대한 SK텔레콤 ALT Labs 연구원들의 견해를 담고 있다. 앞서 연구원들은 컴퓨팅 리소스와 데이터로 과거보다 뛰어난 AI를 구현할 수 있게 됐다고 강조했다. 하지만 여전히 심층적 언어 이해 측면에선 AI가 아직 인간의 수준에 이르지 못했고, 이는 당분간 연구자들의 난제로 남을 것이라고 전망했다.

ALT Labs 연구원들과의 인터뷰 질의응답 후반부를 아래에 정리했다.

Q. 공개된 코버트와 KoGPT2의 한국어 처리성능은 어떤 수준인가요?

A. 네이버 영화 리뷰데이터(NSMC)를 활용한 감정분석 분류작업에 적용시 코버트는 90.1%, KoGPT2는 89.9% 정확도의 성능을 보입니다. 코버트 이전의 언어AI모델은 이 작업에 보통 83~85% 정확도를 보인다고 알려져 있었습니다.

첨언하자면 이 정확도는 '감성 분석'이라는 영역에서의 표현능력을 일부 평가하고 있다고 할 수 있습니다. 일부 작업으로 학습된 언어 모델의 전반적인 표현 성능을 표현하기는 어렵습니다.

Q. 전반적인 한국어 언어처리 분야에서 최근 빠르게 발전한 분야는 무엇인가요?

A. 구글이 선보인 '버트'의 발전으로, 영어뿐아니라 한국어에서도 기계독해(MRC·machine reading comprehension) AI의 성능이 인간의 수준을 뛰어넘었습니다. MRC는 AI가 주어진 문서에서 정답을 찾아내 질의응답 문제를 푸는 데 필요한 능력입니다.

Q. 최신 AI의 언어 이해력이 사람보다 낫다는 말씀인가요?

A. 기계가 인간의 언어를 이해하는데 큰 발전이 있었던 것은 사실이지만, 아직은 피상적인 이해에 머물고 있습니다.

기계가 인간의 언어를 깊이 이해하려면 어떤 사건이나 사실에 대해 인과관계 혹은 그 전후관계의 추론을 바탕으로 한 이해가 필수적입니다. 하지만 당분간 이런 논리적인 언어 이해 문제는 해결하기가 매우 어려울 것으로 예상합니다.

Q. 코버트와 KoGPT2를 개발해 공개하게 된 동기는 무엇인가요?

A. 기술은 사용자에게 편리함과 혜택을 느낄 수 있게 해야 한다고 생각합니다. AI 모델 연구와 관련 기술은 그걸 사용하는 AI 개발자들에게 요긴하게 쓰일 수 있는 기술이어야 하고요.

저희가 공개한 코버트와 KoGPT2가 이런 고민과 과정을 통해 외부에 제공됐습니다. 많은 분들이 편리함과 놀라움을 느끼며 사용하고 있습니다. 외부에 공개할 수 있는 기술을 자신있게 내놓기까지는 많은 노력이 들지만 보람도 큽니다. 다른 연구자, 개발자분들도 저희가 느낀 보람을 다양한 AI 서비스 개발, 연구를 하면서 느낄 수 있길 기대합니다.

Q. 둘 다 '한국어 범용 AI 모델'이라면 하나만 개발돼도 충분하지 않은가요?

A. 모델의 기본적인 성격과 구조의 차이가 있습니다. 코버트 개발에 사용된 버트(BERT)는 주어진 문장의 의미를 이해하는 목적으로 사용될 수 있습니다. KoGPT2 개발에 사용된 GPT-2는 상황에 맞는 문장을 생성하는 데 사용될 수 있습니다.

따라서 어떤 문제에 적용할 것이냐에 따라 여러 AI 모델 중 어떤 것이 더 적합한가가 달라지게 됩니다. 저희는 내부적으로 프로젝트에 따라 적합한 모델을 선택적으로 적용해 왔습니다.

Q. 둘의 차이를 좀 더 설명해 주실 수 있을까요?

A. 버트는 '양방향' 모델입니다. 문장 전체를 왼쪽에서 오른쪽, 오른쪽에서 왼쪽으로 동시에 분석하도록 설계됐습니다. 주어진 문장과 문장 내의 각 단어의 의미를 이해하기 위한 목적을 갖고 있기 때문입니다.

GPT-2는 '단방향' 모델입니다. 일반적으로 왼쪽에서 오른쪽, 단방향으로 (문장을 분석해) 단어를 하나씩 생성하도록 설계됐습니다. 문장을 생성하는 것이 GPT의 주요 목적이기 때문입니다.

Q. ALT Labs에서 다른 AI 모델의 한국어 버전도 내놓을 계획이 있나요?

A. 코버트와 KoGPT2가 각각 '문장 이해'와 '문장 생성' 분야에서 대표적인 모델입니다. 이밖에도, 정확한 모델명을 밝히긴 어렵지만 활용도가 높은 몇 가지 모델의 한국어 버전을 개발하고 있습니다.

Q. 올해 8월 국립국어원이 공개한 '모두의 말뭉치'는 한국어 AI 학습에 유용할까요?

A. 모두의 말뭉치는 그 분량과 다양성에 있어서 기존의 공개 말뭉치와는 매우 다른 규모(13종 18억어절 분량)를 가지고 있습니다. 2000년초 '세종계획'에 의해 2억어절 분량의 정제된 말뭉치가 공개된 이후 근 15년만의 희소식입니다. 이런 대규모 자료를 개인이나 소수 연구 집단에서 수집, 정제하는 것은 거의 불가능한 일입니다.

이 말뭉치는 한국어 언어처리 연구자들이 다양한 언어처리 모델을 개발하고 그 성능을 높이는 데 있어서 획기적인 발전을 가져올 것으로 예상됩니다. 이런 발전에 저희가 공개한 코버트, KoGPT2 모델이 널리 쓰이길 기대하고 있습니다.

당초 영어만 읽고 쓸 줄 아는 두 언어AI 모델에 한국어를 가르친 전문가들이 국내에 있다. SK텔레콤 산하의 'AI랭귀지테크랩스(ALT Labs)' 소속 연구원들이다. 이들은 작년 10월과 올해 2월 각각 한국어를 익힌 코버트(KoBERT)와 KoGPT2를 선보였다. SK텔레콤 언어AI 기술 분야의 연구 성과와 발전 방향을 가늠하기 위해, 이들과의 서면 인터뷰를 진행했다.

ALT Labs의 데이비스 에릭 하트만 소장, 김태윤 리더, 김진 리서치엔지니어, 전희원 리서치엔지니어, 4명이 함께 질의에 답했다. 지난주 보도된 "SK텔레콤은 '언어신동 AI’에 어떻게 한국어를 가르쳤을까"가 이번 인터뷰의 답변 가운데 극히 일부분만을 담은 첫 기사다. 전체 인터뷰 질의응답을 주제별로 재배치해 두 편으로 재정리했다.

[사진=게티이미지뱅크]

후반부인 이번 편은 언어AI 분야의 성취와 한계에 대한 SK텔레콤 ALT Labs 연구원들의 견해를 담고 있다. 앞서 연구원들은 컴퓨팅 리소스와 데이터로 과거보다 뛰어난 AI를 구현할 수 있게 됐다고 강조했다. 하지만 여전히 심층적 언어 이해 측면에선 AI가 아직 인간의 수준에 이르지 못했고, 이는 당분간 연구자들의 난제로 남을 것이라고 전망했다.

Q. 공개된 코버트와 KoGPT2의 한국어 처리성능은 어떤 수준인가요?

A. 네이버 영화 리뷰데이터(NSMC)를 활용한 감정분석 분류작업에 적용시 코버트는 90.1%, KoGPT2는 89.9% 정확도의 성능을 보입니다. 코버트 이전의 언어AI모델은 이 작업에 보통 83~85% 정확도를 보인다고 알려져 있었습니다.

첨언하자면 이 정확도는 '감성 분석'이라는 영역에서의 표현능력을 일부 평가하고 있다고 할 수 있습니다. 일부 작업으로 학습된 언어 모델의 전반적인 표현 성능을 표현하기는 어렵습니다.

Q. 전반적인 한국어 언어처리 분야에서 최근 빠르게 발전한 분야는 무엇인가요?

A. 구글이 선보인 '버트'의 발전으로, 영어뿐아니라 한국어에서도 기계독해(MRC·machine reading comprehension) AI의 성능이 인간의 수준을 뛰어넘었습니다. MRC는 AI가 주어진 문서에서 정답을 찾아내 질의응답 문제를 푸는 데 필요한 능력입니다.

Q. 최신 AI의 언어 이해력이 사람보다 낫다는 말씀인가요?

A. 기계가 인간의 언어를 이해하는데 큰 발전이 있었던 것은 사실이지만, 아직은 피상적인 이해에 머물고 있습니다.

기계가 인간의 언어를 깊이 이해하려면 어떤 사건이나 사실에 대해 인과관계 혹은 그 전후관계의 추론을 바탕으로 한 이해가 필수적입니다. 하지만 당분간 이런 논리적인 언어 이해 문제는 해결하기가 매우 어려울 것으로 예상합니다.

Q. 코버트와 KoGPT2를 개발해 공개하게 된 동기는 무엇인가요?

A. 기술은 사용자에게 편리함과 혜택을 느낄 수 있게 해야 한다고 생각합니다. AI 모델 연구와 관련 기술은 그걸 사용하는 AI 개발자들에게 요긴하게 쓰일 수 있는 기술이어야 하고요.

저희가 공개한 코버트와 KoGPT2가 이런 고민과 과정을 통해 외부에 제공됐습니다. 많은 분들이 편리함과 놀라움을 느끼며 사용하고 있습니다. 외부에 공개할 수 있는 기술을 자신있게 내놓기까지는 많은 노력이 들지만 보람도 큽니다. 다른 연구자, 개발자분들도 저희가 느낀 보람을 다양한 AI 서비스 개발, 연구를 하면서 느낄 수 있길 기대합니다.

Q. 둘 다 '한국어 범용 AI 모델'이라면 하나만 개발돼도 충분하지 않은가요?

A. 모델의 기본적인 성격과 구조의 차이가 있습니다. 코버트 개발에 사용된 버트(BERT)는 주어진 문장의 의미를 이해하는 목적으로 사용될 수 있습니다. KoGPT2 개발에 사용된 GPT-2는 상황에 맞는 문장을 생성하는 데 사용될 수 있습니다.

따라서 어떤 문제에 적용할 것이냐에 따라 여러 AI 모델 중 어떤 것이 더 적합한가가 달라지게 됩니다. 저희는 내부적으로 프로젝트에 따라 적합한 모델을 선택적으로 적용해 왔습니다.

Q. 둘의 차이를 좀 더 설명해 주실 수 있을까요?

A. 버트는 '양방향' 모델입니다. 문장 전체를 왼쪽에서 오른쪽, 오른쪽에서 왼쪽으로 동시에 분석하도록 설계됐습니다. 주어진 문장과 문장 내의 각 단어의 의미를 이해하기 위한 목적을 갖고 있기 때문입니다.

GPT-2는 '단방향' 모델입니다. 일반적으로 왼쪽에서 오른쪽, 단방향으로 (문장을 분석해) 단어를 하나씩 생성하도록 설계됐습니다. 문장을 생성하는 것이 GPT의 주요 목적이기 때문입니다.

Q. ALT Labs에서 다른 AI 모델의 한국어 버전도 내놓을 계획이 있나요?

A. 코버트와 KoGPT2가 각각 '문장 이해'와 '문장 생성' 분야에서 대표적인 모델입니다. 이밖에도, 정확한 모델명을 밝히긴 어렵지만 활용도가 높은 몇 가지 모델의 한국어 버전을 개발하고 있습니다.

Q. 올해 8월 국립국어원이 공개한 '모두의 말뭉치'는 한국어 AI 학습에 유용할까요?

A. 모두의 말뭉치는 그 분량과 다양성에 있어서 기존의 공개 말뭉치와는 매우 다른 규모(13종 18억어절 분량)를 가지고 있습니다. 2000년초 '세종계획'에 의해 2억어절 분량의 정제된 말뭉치가 공개된 이후 근 15년만의 희소식입니다. 이런 대규모 자료를 개인이나 소수 연구 집단에서 수집, 정제하는 것은 거의 불가능한 일입니다.

이 말뭉치는 한국어 언어처리 연구자들이 다양한 언어처리 모델을 개발하고 그 성능을 높이는 데 있어서 획기적인 발전을 가져올 것으로 예상됩니다. 이런 발전에 저희가 공개한 코버트, KoGPT2 모델이 널리 쓰이길 기대하고 있습니다.

코버트와 KoGPT2 개발에 참여한 SK텔레콤 ALT Labs 연구원들. (왼쪽위부터 시계방향으로) 전희원 리서치엔지니어, 김진 리서치엔지니어, 데이비스 에릭 하트만 소장, 김태윤 리더. [사진=SK텔레콤 제공]

©'5개국어 글로벌 경제신문' 아주경제. 무단전재·재배포 금지

![[르포] 중력 6배에 짓눌려 기절 직전…전투기 조종사 비행환경 적응훈련(영상)](https://image.ajunews.com/content/image/2024/02/29/20240229181518601151_258_161.jpg)