[사진=게티이미지뱅크]

10일 한국공학한림원은 '대한민국 초거대 AI 시대를 열어가기 위한 AI 반도체 기술' 웨비나를 열고 국내 AI 소프트웨어(모델)·하드웨어(반도체) 전문가와 정부 관계자를 초청해 토론을 진행했다.

◆막대한 운영비 드는 초거대 AI...메모리 특화 AI 반도체가 해법

이동수 네이버클라우드 이사는 "초거대 AI는 결국 비용 문제로 요약된다. 오픈AI는 일일 수십억원의 비용을 들여 챗GPT를 운영 중이고, 마이크로소프트의 AI 기반 검색은 일반 검색 대비 운영비가 100~200배 더 필요할 것으로 예상된다"며 "운영 비용을 최소화하면서 초거대 AI 서비스를 제공하는 것이 곧 IT 기업들의 화두로 떠오를 것"이라고 밝혔다.

이동수 이사는 "챗GPT를 포함한 생성 AI는 질문에 대한 답변을 하는 과정에서 CPU(중앙처리장치)·GPU(그래픽처리장치)보다 메모리에서 데이터를 처리하는 비중이 크다"며 "초거대 AI 모델 학습·추론 시 메모리에 부하가 걸리는 문제를 해결하려는 것이 네이버와 삼성전자가 함께 AI 반도체 개발에 나선 동기"라고 설명했다.

현재 챗GPT는 하루 1500만명 이상의 이용자가 몰리면서 메모리 부하로 인해 답변이 느려지는 문제가 생겼는데, 이 문제를 해결하지 않으면 오픈AI와 마이크로소프트도 큰 어려움에 봉착할 것이라는 게 이동수 이사의 설명이다.

그는 이렇게 메모리에 중점을 두고 설계된 AI 반도체의 대표 사례로 구글 'TPU(텐서플로유닛)'를 꼽았다. TPU1(45nm)에서 TPU4(7nm)로 업그레이드하면서 CPU(중앙처리장치), S램, D램 성능은 크게 변한 게 없는 반면 GDDR 메모리와 HBM 메모리 성능은 혁신적으로 발전했다는 것이다.

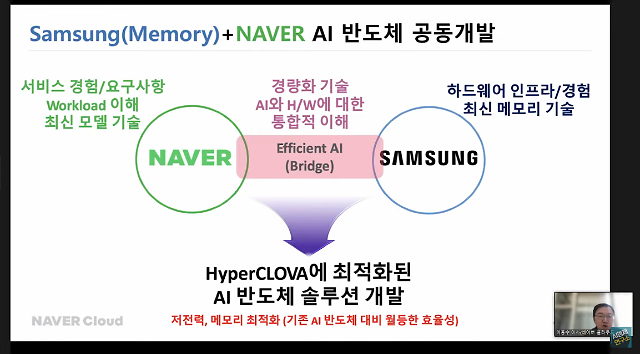

이동수 이사는 이렇게 AI 반도체에서 메모리의 중요성이 커지는 현상은 삼성전자, SK하이닉스 등 고용량 집적 메모리를 만들 수 있는 세계 1·2위 업체를 보유한 한국에 큰 기회가 될 것으로 내다봤다. 네이버와 삼성전자는 네이버의 초거대 AI 설계·운영 역량과 삼성전자의 하드웨어 인프라 경험 및 최신 메모리 기술을 결합해 하이퍼클로바에 최적화한 AI 반도체를 개발하기로 했다. 메모리 최적화와 저전력에 집중함으로써 엔비디아 등 기존 AI 반도체 대비 월등한 운영 효율성을 내는 게 목표다.

AI 경량화는 모델 알고리즘을 특정 AI 반도체에 맞게 최적화함으로써 더 적은 AI 모델 규모와 AI 반도체 전력 소모로도 경량화 전과 같거나 더 우수한 성능을 내는 기술이다. 이동수 이사는 "AI 경량화를 위해 네이버와 삼성전자가 원팀이 되어 움직이고 있다"며 "양사의 소프트웨어와 하드웨어 전반을 재검토하는 수준"이라고 밝혔다.

이동수 네이버클라우드 이사가 네이버·삼성전자 AI 반도체 개발 계획에 대해 설명하고 있다. [사진=한국공학한림원]

KT·KT클라우드와 협력해 자연어 처리에 특화한 AI 반도체를 만든 리벨리온 박성현 대표는 "최적의 AI 반도체를 설계하려면 단순히 소프트웨어를 넘어 AI 알고리즘까지 이해해야 한다"며 "리벨리온은 반응속도(레이턴시)와 금융에 특화한 추론용 AI 반도체를 개발해 먼저 KT의 초거대 AI(믿음)와 AICC 실행에 필요한 하드웨어 인프라를 엔비디아 GPU에서 리벨리온 AI 반도체로 바꾼 후 AI 반도체를 클라우드를 통해 외부에 공개할 것"이라고 밝혔다.

박성현 대표는 "학습과 추론은 반도체 칩 규모(스케일)에서 차이가 있다. AI 반도체의 규모가 커지면 필연적으로 관련 개발 비용과 운영 비용(전기료)이 커질 수밖에 없다"며 국산 AI 반도체는 추론과 저전력에 집중함으로써 기업들의 AI 서비스 운영 비용을 절감하는 데 집중해야 한다는 입장을 내비쳤다. 장기적으론 다양한 산업 분야에 특화한 초거대 AI를 실행할 수 있는 다종의 AI 반도체를 만들겠다는 계획도 내놨다.

이날 행사에선 엔비디아가 97% 점유율로 독주 중인 데이터센터용 AI 반도체 시장에서 국산 AI 반도체가 점유율과 영향력을 확대할 수 있는 방안이 집중 논의됐다.

이동수 이사는 "엔비디아가 AI 반도체 성능이 좋은 것은 부인할 수가 없는 사실이다. 기업 입장에서 비용을 더 내더라도 많은 서비스를 제공할 수 있는 만큼 선호도가 높다"며 "특히 초거대 AI 구현을 위한 기술 흐름이 합성곱(CNN)과 순환 신경망(RNN)에서 트랜스포머 모델로 바뀌는 상황에서 (엔비디아가) 관련 생태계 구축이 가장 빨랐다"고 설명했다.

박성현 대표는 학습용 AI 반도체 시장은 당분간 엔비디아가 독주할 것으로 예상되는 만큼 국내 AI 반도체 기업은 지연시간을 단축하는 등 추론용 AI 반도체 관련 기술 경쟁력을 확보해야 한다고 강조했다.

그는 "새 제품(국산 AI 반도체)이 시장에 받아들여지려면 고객의 습관을 바꿔야 하는데, 그게 어렵다. 새 AI 반도체가 좋은 것을 알아도 관성적으로 기존 제품(엔비디아)을 쓰는 경우가 많다"며 "국산 AI 반도체가 시장에서 받아들여질 때까지 버틸 체력·자본·참을성이 필요할 것으로 본다. 초거대 AI를 포함해 AI를 개발하는 국내외 기업과 컨소시엄을 구성하는 것도 관련 수요를 확보할 수 있는 한 방법"이라고 말했다.

윤두희 과학기술정보통신부 정보통신방송기술정책과 과장은 딥러닝의 아버지 제프리 힌튼 토론토대 교수가 윤석열 대통령과 만나 "AI 혁명은 앞으로 한 번 더 일어난다. 다가올 혁명은 하드웨어 혁신으로 이뤄질 것"이라고 말한 것을 인용해 현재 GPU 기반 AI 인프라는 지속가능성이 낮다고 강조했다.

이에 정부는 '국산 AI 반도체를 활용한 K-클라우드 추진 계획'을 통해 국내 AI 반도체 기업이 초기 수요를 확보하고 고객 사례를 확대할 수 있도록 연내 국산 AI 반도체팜(NPU팜)을 광주광역시를 포함해 2곳에 구축할 계획이다.

©'5개국어 글로벌 경제신문' 아주경제. 무단전재·재배포 금지

![[르포] 중력 6배에 짓눌려 기절 직전…전투기 조종사 비행환경 적응훈련(영상)](https://image.ajunews.com/content/image/2024/02/29/20240229181518601151_258_161.jpg)